C'est pas moi

Vous utilisez un navigateur obsolète. Il se peut que ce site ou d'autres sites Web ne s'affichent pas correctement.

Vous devez le mettre à jour ou utiliser un navigateur alternatif.

Vous devez le mettre à jour ou utiliser un navigateur alternatif.

Gaza : Nous sommes témoins

- Initiateur de la discussion mac77

- Date de début

Ça n'est pas la seule, la Suisse "neutre" aussiMerci la France pour ses livraisons d'armes. Le pays des droits de l'Homme

LA PLUS GRANDE MANIFESTATION ANTI-GOUVERNEMENTALE EN ISRAËL DEPUIS LE 7 OCTOBRE

Des dizaines de milliers d’Israéliens ont bloqué plusieurs rues vitales de Tel Aviv, lors d’une immense manifestation pour exiger la conclusion d’un accord d’échange immédiat avec les Palestiniens.Puis, ils franchissent les barrières de police et veulent marcher vers la résidence du Premier ministre à Jérusalem.

AFFRONTEMENTS DEVANT LE PARLEMENT A JÉRUSALEM

CAPJPO-EuroPalestine

NowHereMan

...

“C’est à devenir fou !” déplore un réserviste israélien

Témoignage. Guerre à Gaza : “C’est à devenir fou !” déplore un réserviste israélien

Dans un rare témoignage sur les atrocités de la guerre à Gaza et les dérives au sein de Tsahal, un réserviste démobilisé brise le silence et livre un récit boul...

www.courrierinternational.com

www.courrierinternational.com

Témoignage. Guerre à Gaza : “C’est à devenir fou !” déplore un réserviste israélien

Dans un rare témoignage sur les atrocités de la guerre à Gaza et les dérives au sein de Tsahal, un réserviste démobilisé brise le silence et livre un récit boul...

“Pourquoi je ne me révolte pas contre ça ?”

J’ai vu des Palestiniens être emmenés dans le coffre d’un Hummer et des militaires israéliens les battre quasi à mort. J’ai vu des soldats déverser leur rage sur des biens palestiniens et des Palestiniens eux-mêmes, sans aucune raison. Et, en silence, je me suis demandé : “Bordel, qu’est-ce que je fous ici ? Pourquoi je ne me révolte pas contre ça ?”

Source :

Témoignage. Guerre à Gaza : “C’est à devenir fou !” déplore un réserviste israélien

Dans un rare témoignage sur les atrocités de la guerre à Gaza et les dérives au sein de Tsahal, un réserviste démobilisé brise le silence et livre un récit boul...

L’IA utilisée par Tsahal cible les militants du Hamas «quand ils sont avec leur famille, pas dans des bâtiments militaires», dévoilent des lanceurs d’alerte

«Il est beaucoup plus facile de bombarder la maison d'une famille», explique le journaliste Yuval Abraham, qui se base sur des témoignages au sein des FDI et du renseignement.

De fait, le système automatisé de l’IA Lavender - baptisé "Where's Daddy ?" (Où est papa ?) - «est conçu pour les rechercher dans ces situations».

[L'armée israélienne] a systématiquement attaqué les individus ciblés alors qu'ils se trouvaient chez eux - généralement la nuit en présence de toute leur famille - plutôt qu'au cours d'une activité militaire

«Les FDI les ont bombardés dans leurs maisons sans hésitation, comme première option.»

Avec pour résultat évident des pertes civiles catastrophiques, ce qui est parfaitement intégré: «il était permis de tuer jusqu'à 15 ou 20 civils pour chaque subalterne du Hamas marqué par Lavender.»

Et si la cible est un haut responsable du Hamas, le ratio «acceptable» monte à 100 civils.

A part ça, «accuser l'Etat juif de génocide, c'est franchir un seuil moral», selon Stéphane Séjourné.

Personne2

VIB

Exécutions, viols... Des expertes de l'ONU s'alarment des violences contre les femmes à Gaza

Des expertes mandatées par l'ONU ont exigé lundi une enquête après des accusations d'exécutions et de viols par les forces israéliennes contre des femmes et filles palestiniennes à Gaza et en Cisjordanie. Elles dénoncent des "traitements inhumains et dégradants", des agressions sexuelles, et des détentions et exécutions arbitraires.

www.france24.com

www.france24.com

Des expertes mandatées par l'ONU ont exigé lundi une enquête après des accusations d'exécutions et de viols par les forces israéliennes contre des femmes et filles palestiniennes à Gaza et en Cisjordanie. Elles dénoncent des "traitements inhumains et dégradants", des agressions sexuelles, et des détentions et exécutions arbitraires.

Exécutions, viols... Des expertes de l'ONU s'alarment des violences contre les femmes à Gaza

Des expertes mandatées par l'ONU ont exigé lundi une enquête après des accusations d'exécutions et de viols par les forces israéliennes contre des femmes et filles palestiniennes à Gaza et en Cisjordanie.…

NowHereMan

...

Chaque jour, le monde découvre les atrocités des sionistes qui ont perdu toute humanité.

Les images choquantes montrent des mercenaires des colonisateurs sionistes. qui tirent délibérément sur des civils palestiniens. Ces barbares quand ils ne peuvent affronter les palestiniens profitent de la situation quand des civils s'approche des aides humanitaires larguée par des avions. les tireurs assassinent des personnes innocentes qui ne constituent aucun dangers pour les pampers génocidaires et les corps sont dévorés de ces malheureuses victimes sont dévorés par des chiens affamés.

Regarde la pièce jointe doamuslims_488p_20240405_075108.mp4

Les images choquantes montrent des mercenaires des colonisateurs sionistes. qui tirent délibérément sur des civils palestiniens. Ces barbares quand ils ne peuvent affronter les palestiniens profitent de la situation quand des civils s'approche des aides humanitaires larguée par des avions. les tireurs assassinent des personnes innocentes qui ne constituent aucun dangers pour les pampers génocidaires et les corps sont dévorés de ces malheureuses victimes sont dévorés par des chiens affamés.

Regarde la pièce jointe doamuslims_488p_20240405_075108.mp4

Exécutions, viols... Des expertes de l'ONU s'alarment des violences contre les femmes à Gaza

Des expertes mandatées par l'ONU ont exigé lundi une enquête après des accusations d'exécutions et de viols par les forces israéliennes contre des femmes et filles palestiniennes à Gaza et en Cisjordanie. Elles dénoncent des "traitements inhumains et dégradants", des agressions sexuelles, et des détentions et exécutions arbitraires.

Exécutions, viols... Des expertes de l'ONU s'alarment des violences contre les femmes à Gaza

Des expertes mandatées par l'ONU ont exigé lundi une enquête après des accusations d'exécutions et de viols par les forces israéliennes contre des femmes et filles palestiniennes à Gaza et en Cisjordanie.…www.france24.com

NowHereMan

...

Personne2

VIB

Humanitaires tués à Gaza : pour le vice-président de Médecins du monde, "il y a un message envoyé par l'armée israélienne"

L'ONG World Central Kitchen, où travaillaient les victimes, était censée mettre en pratique les propositions américaines de corridors humanitaires pour essayer d'enrayer la famine dans Gaza, explique Jean-François Corty.

Humanitaires tués à Gaza : pour le vice-président de Médecins du monde, "il y a un message envoyé par l'armée israélienne"

L'ONG World Central Kitchen, où travaillaient les victimes, était censée mettre en pratique les propositions américaines de corridors humanitaires pour essayer d'enrayer la famine dans Gaza, explique Jean-François Corty.

"Washington appelle au cessez-le-feu et exige une protection accrue des civils" Le Figaro (propriété de Dassault, société qui envoyait des mirages en pièce détachée à Israel pendant les guerres arabes (quand ils en avaient sous la djellaba)

La bonne blague. Les bombes et autres missiles qui tombent sur les Palestiniens, peuple respectable et millénaire abandonné par la lâcheté arabo-couscous-mumu, sont principalement du matériel américain.

++

La bonne blague. Les bombes et autres missiles qui tombent sur les Palestiniens, peuple respectable et millénaire abandonné par la lâcheté arabo-couscous-mumu, sont principalement du matériel américain.

++

La non inaction des chefs d’états du monde, révèlent qu’ils sont tous tenus les uns les autres par des accords qui nous dépassent... le vrai peuple élu, est le peuple palestinien, et le grand réveil passe par lui.

Y en a marre des peuples élus, à tous les sauces !le vrai peuple élu, est le peuple palestinien,

NowHereMan

...

Un convoi de l'ONU a atteint l'hôpital d'Al Shifa pour la première fois depuis le siège de 2 semaines de l'armée israélienne et ce qu'ils y ont découvert dépasse l'entendement... Destruction totale de l'hôpital, le sort atrice des civils , des corps gisent sur les routes

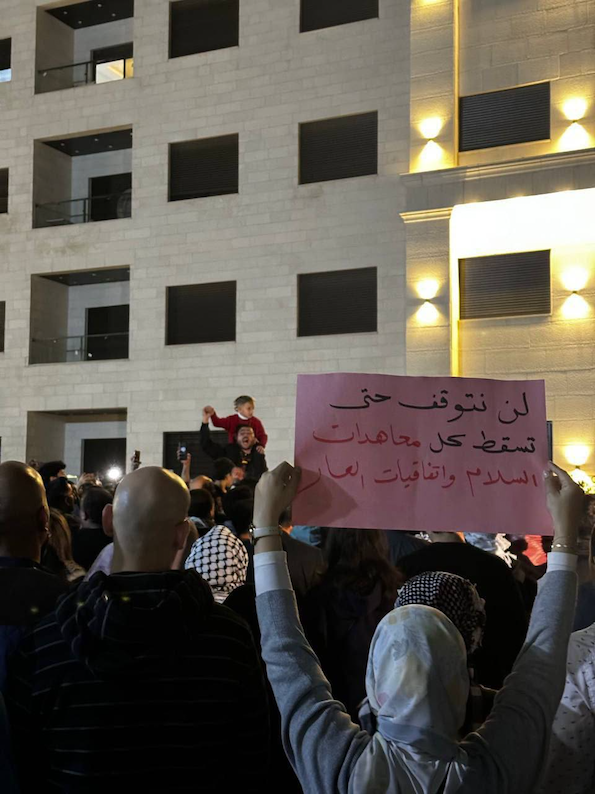

« Face au nombre intolérable de victimes », les présidents français et égyptien et le roi de Jordanie exigent, dans une tribune commune

au Monde, le respect des résolutions de l’ONU, un cessez-le-feu permanent à Gaza et la libération de tous les otages.

-> voeu pieux. Ils croient encore aux miracles de l'Aid El Fitr alors que pour la 27ème nuit du Ramadan (nuit du destin), les prières du peuple martyre de Palestine sont restées lettres mortes.

++

au Monde, le respect des résolutions de l’ONU, un cessez-le-feu permanent à Gaza et la libération de tous les otages.

-> voeu pieux. Ils croient encore aux miracles de l'Aid El Fitr alors que pour la 27ème nuit du Ramadan (nuit du destin), les prières du peuple martyre de Palestine sont restées lettres mortes.

++

mioulo

VIB

C'est toutbidon.com« Face au nombre intolérable de victimes », les présidents français et égyptien et le roi de Jordanie exigent, dans une tribune commune

au Monde, le respect des résolutions de l’ONU, un cessez-le-feu permanent à Gaza et la libération de tous les otages.

Regarde la pièce jointe 384862

-> voeu pieux. Ils croient encore aux miracles de l'Aid El Fitr alors que pour la 27ème nuit du Ramadan (nuit du destin), les prières du peuple martyre de Palestine sont restées lettres mortes.

++

Si ils le voulaient ils pourraient arrêter ces sociopathes, mais tlm s'en fiche des palestiniens.

Personne2

VIB

Macron dans toute sa splendeur , blablabla mais :« Face au nombre intolérable de victimes », les présidents français et égyptien et le roi de Jordanie exigent, dans une tribune commune

au Monde, le respect des résolutions de l’ONU, un cessez-le-feu permanent à Gaza et la libération de tous les otages.

Regarde la pièce jointe 384862

-> voeu pieux. Ils croient encore aux miracles de l'Aid El Fitr alors que pour la 27ème nuit du Ramadan (nuit du destin), les prières du peuple martyre de Palestine sont restées lettres mortes.

++

Il n’arrêtera les ventes d’armes a Israël

Il ne demandera pas la suspension des accords de libre échange entre l’Europe et Israël!

Et pas un mot pour les ressortissants Français qui combattent dans les rangs de l'armée israélienne et se rendent complice de crimes de guerre à minima .

Personne2

VIB

A Gaza sont testés les armes de demain , pour faire la guerre dans des milieux densément peuplé avec un minimum de soldats ...De quoi intéressé de nombreux dictateurs , clients potentiels pour faire la guerre à leur propre peuple !

«CheckNews» a rassemblé les informations disponibles sur les IA israéliennes qui permettent à l’armée de frapper la bande de Gaza avec une intensité inédite.

Ils permettent à l’armée israélienne d’agréger les données de renseignement, de générer des «kills list» de dizaines de milliers de personnes, et de démultiplier les frappes à un rythme inédit, au point que le nombre de munitions semble être la seule limite. A l’automne, Libération avait expliqué comment l’emploi d’outils d’intelligence artificielle (IA) par l’armée israélienne expliquait l’intensité inédite des bombardements à Gaza. Peu à peu, le détail de cet arsenal d’un nouveau genre est mis au jour. Après une première enquête consacrée au sujet fin novembre, le média israélo-palestinien +972 Magazine a publié début avril un nouveau volet de son investigation, révélant l’existence de nouveaux algorithmes particulièrement dévastateurs.

[...]

Cette IA a été révélée et décrite dans la dernière enquête du média +972 publiée il y a quelques jours. Là où Gospel désigne des bâtiments à partir de données de renseignement, Lavender désigne des personnes. Selon le média israélo-palestinien, durant les premières semaines du conflit, Lavender aurait «marqué» jusqu’à 37 000 Palestiniens comme «militants présumés», leurs maisons étant cataloguées «en vue d’éventuelles frappes aériennes». L’enquête journalistique affirme (témoignages de militaires ayant utilisé ces outils depuis octobre à l’appui) qu’en pratique, les listes seraient utilisées sans que ne soit exigée de vérification approfondie des raisons pour lesquelles la machine a fait ces choix, ni d’évaluation des données de renseignement traitées par l’IA. Le rôle de l’humain se limiterait donc, en pratique, à «entériner les décisions de la machine». Une source interrogée par les journalistes précise qu’il consacrait une vingtaine de secondes à l’examen de chaque cible marquée par Lavender, «juste pour s’assurer qu’il s’agit bien d’un homme». Selon +972, l’efficacité de Lavender a été testée, au début du conflit, sur un échantillon de Palestiniens, avec une efficacité «de 90 %» pour «l’identification de l’affiliation d’un individu avec le Hamas». L’article suggère qu’il pourrait s’agir non seulement de la «sensibilité» de l’IA (sa capacité à identifier un membre du Hamas comme tel), mais également de sa «spécificité» (sa capacité à ne pas accuser à tort un civil d’être affilié au Hamas). Si ce dernier point reste peu clair, les témoignages recueillis affirment que l’IA est connue «pour marquer occasionnellement des individus qui n’ont qu’un lien ténu avec des groupes militants, voire aucun lien du tout». La marge d’erreur dans la spécificité de Lavender serait, quoi qu’il en soit, considérée comme acceptable par l’armée – qui frappe dans tous les cas.

:quality(70):focal(2285x2820:2295x2830)/cloudfront-eu-central-1.images.arcpublishing.com/liberation/K7UWYGZEXVFYXBV3TKW76HVZVE.jpg)

www.liberation.fr

www.liberation.fr

«CheckNews» a rassemblé les informations disponibles sur les IA israéliennes qui permettent à l’armée de frapper la bande de Gaza avec une intensité inédite.

Ils permettent à l’armée israélienne d’agréger les données de renseignement, de générer des «kills list» de dizaines de milliers de personnes, et de démultiplier les frappes à un rythme inédit, au point que le nombre de munitions semble être la seule limite. A l’automne, Libération avait expliqué comment l’emploi d’outils d’intelligence artificielle (IA) par l’armée israélienne expliquait l’intensité inédite des bombardements à Gaza. Peu à peu, le détail de cet arsenal d’un nouveau genre est mis au jour. Après une première enquête consacrée au sujet fin novembre, le média israélo-palestinien +972 Magazine a publié début avril un nouveau volet de son investigation, révélant l’existence de nouveaux algorithmes particulièrement dévastateurs.

[...]

Cette IA a été révélée et décrite dans la dernière enquête du média +972 publiée il y a quelques jours. Là où Gospel désigne des bâtiments à partir de données de renseignement, Lavender désigne des personnes. Selon le média israélo-palestinien, durant les premières semaines du conflit, Lavender aurait «marqué» jusqu’à 37 000 Palestiniens comme «militants présumés», leurs maisons étant cataloguées «en vue d’éventuelles frappes aériennes». L’enquête journalistique affirme (témoignages de militaires ayant utilisé ces outils depuis octobre à l’appui) qu’en pratique, les listes seraient utilisées sans que ne soit exigée de vérification approfondie des raisons pour lesquelles la machine a fait ces choix, ni d’évaluation des données de renseignement traitées par l’IA. Le rôle de l’humain se limiterait donc, en pratique, à «entériner les décisions de la machine». Une source interrogée par les journalistes précise qu’il consacrait une vingtaine de secondes à l’examen de chaque cible marquée par Lavender, «juste pour s’assurer qu’il s’agit bien d’un homme». Selon +972, l’efficacité de Lavender a été testée, au début du conflit, sur un échantillon de Palestiniens, avec une efficacité «de 90 %» pour «l’identification de l’affiliation d’un individu avec le Hamas». L’article suggère qu’il pourrait s’agir non seulement de la «sensibilité» de l’IA (sa capacité à identifier un membre du Hamas comme tel), mais également de sa «spécificité» (sa capacité à ne pas accuser à tort un civil d’être affilié au Hamas). Si ce dernier point reste peu clair, les témoignages recueillis affirment que l’IA est connue «pour marquer occasionnellement des individus qui n’ont qu’un lien ténu avec des groupes militants, voire aucun lien du tout». La marge d’erreur dans la spécificité de Lavender serait, quoi qu’il en soit, considérée comme acceptable par l’armée – qui frappe dans tous les cas.

:quality(70):focal(2285x2820:2295x2830)/cloudfront-eu-central-1.images.arcpublishing.com/liberation/K7UWYGZEXVFYXBV3TKW76HVZVE.jpg)

Lavender, Gospel, Depth of Wisdom, Firefactory : comment lâIA est utilisée par Israël dans sa guerre à Gaza

«CheckNews» a rassemblé les informations disponibles sur les IA israéliennes qui permettent à l’armée de frapper la bande de Gaza avec une intensité inédite.

Ces c.rapules sionardes n'ont aucune limites dans la crapulerie.

Le jour de l'Aïd ils ont bombardés un rassemblement de palestiniens qqui fêtaient le jour de l'aïd. De nombreux morts dont des enfants...

information.tv5monde.com

information.tv5monde.com

Le jour de l'Aïd ils ont bombardés un rassemblement de palestiniens qqui fêtaient le jour de l'aïd. De nombreux morts dont des enfants...

Bombardements israéliens meurtriers sur Gaza, au premier jour de l'Aïd el-Fitr

Monde

On aura jamais vu des barbares de ce niveau. Quelle horreur. Je n'ose visionner.Ces c.rapules sionardes n'ont aucune limites dans la crapulerie.

Le jour de l'Aïd ils ont bombardés un rassemblement de palestiniens qqui fêtaient le jour de l'aïd. De nombreux morts dont des enfants...

Bombardements israéliens meurtriers sur Gaza, au premier jour de l'Aïd el-Fitr

Mondeinformation.tv5monde.com

Ils ont fait de même pour pâques.

Aucun répis pour ce pauvre peuple.

Que tu le veuilles ou non, la peuple palestinien fait l’unanimité dans le cœur des peuples du monde... Tu n’as qu’à voir les multiples manifestations de soutien, à travers le monde... aucun autre peuple n’avait autant rassembléY en a marre des peuples élus, à tous les sauces !

Si ils le voulaient ils pourraient arrêter ces sociopathes, mais tlm s'en fiche des palestiniens.

On verra ! l'Espagne semble bouger pour trouver enfin une solution ! mais est-ce que tout le monde veut une solution ! et je parle pour les deux parties du problèmeQue tu le veuilles ou non, la peuple palestinien fait l’unanimité dans le cœur des peuples du monde.

NowHereMan

...

La ligue de l'horreur: Israel est en compétition avec le nazisme pour la première place.

is competing with Nazism for first place in the league of horror in the history of mankind. We demand a stop to genocide now.

is competing with Nazism for first place in the league of horror in the history of mankind. We demand a stop to genocide now.

Partagez cette discussion: